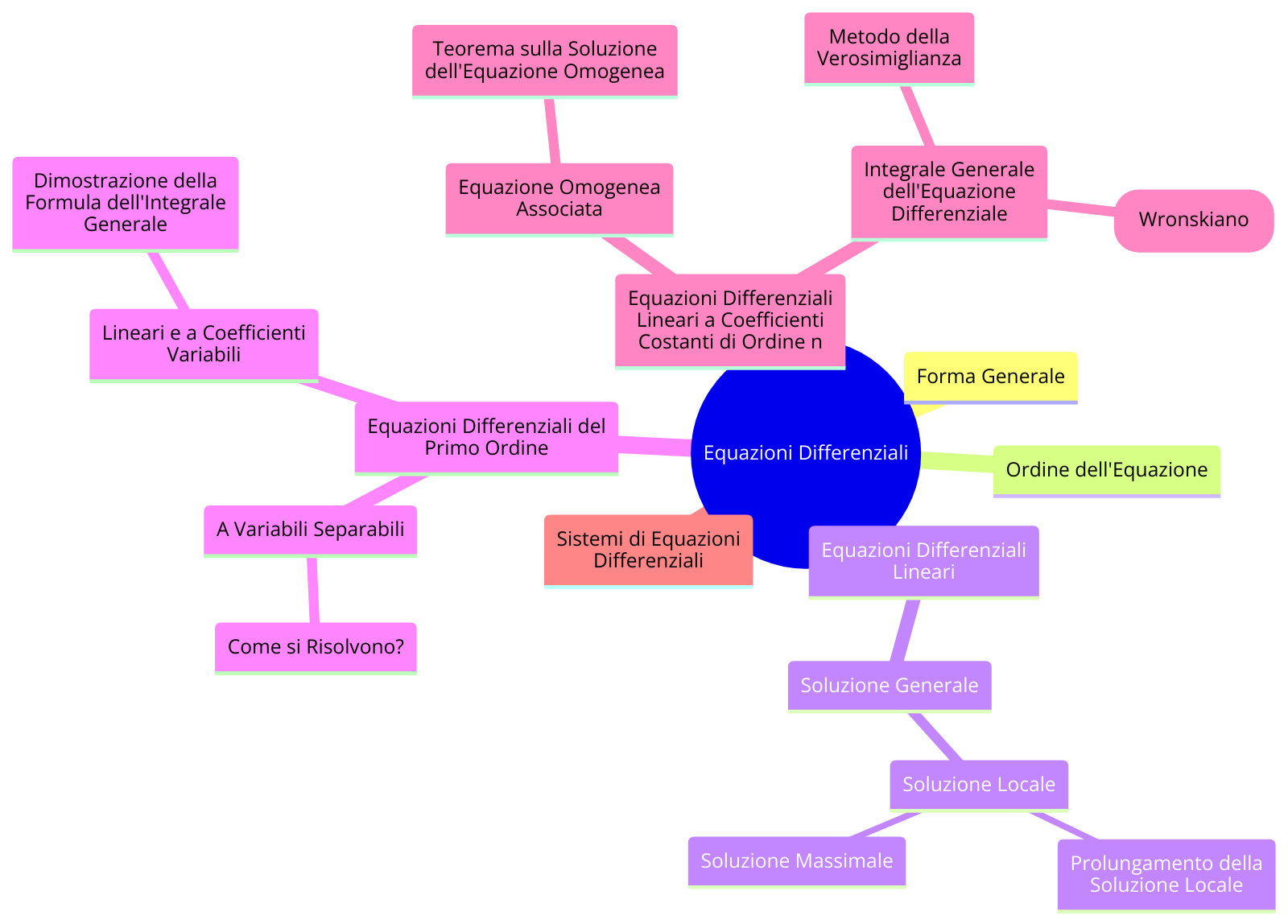

Indice dei contenuti

- Forma generale di un equazione differenziale

- Soluzione di un equazione differenziale

- Equazioni differenziali del primo ordine a variabili separabili

- Equazioni differenziali del primo ordine lineari e a coefficienti variabili

- Equazioni differenziali lineari a coefficienti costanti di ordine n

- Sistemi di equazioni differenziali

- Sistemi di equazioni differenziali omogenee del primo ordine 2×2

- Bibliografia

Forma generale di un equazione differenziale

Un sistema di equazioni differenziali di ordine $n$, può essere espresso dalla seguente equazione, dove $x$ è una variabile dell’equazione, ma a differenza di altri tipi di equazioni, si tratta di una funzione della variabile $t$ e compare anche sotto forma di derivata prima, derivata seconda, .. , fino all’ordine n:

$$\Phi \left( t,x,x’,x”,…,{{x}^{(n)}} \right)=0$$

L’equazione di per se ammette infinite soluzioni, mentre può ammettere una sola soluzione se si presenta in un sistema, chiamato Problema di Cauchy, che aggiunge una serie di condizioni iniziali, e sono tante per quanto è l’ordine dell’equazione differenziale.

\[ \left\{ \begin{align*} & \Phi \left( t,x,x’,x”,\ldots, x^{(n)} \right)=0 \\ & x'(t_1)=\beta_1 \\ & x”(t_2)=\beta_2 \\ & \vdots \\ & x^{(n)}(t_n)=\beta_n \\ \end{align*} \right. \]

Dove:

– \(\Phi\) è una funzione che dipende dalla variabile \(t\) e dalle derivate \(x, x’, x”, \ldots, x^{(n)}\),

– \(x(t)\) è la funzione incognita che si vuole trovare,

– \(x'(t_1)=\beta_1\) indica una condizione iniziale o al contorno sulla derivata prima di \(x\),

– \(x”(t_2)=\beta_2\) indica una condizione iniziale o al contorno sulla derivata seconda di \(x\),

– \(x^{(n)}(t_n)=\beta_n\) indica una condizione iniziale o al contorno sulla derivata di ordine \(n\) di \(x\).

Questo tipo di equazioni è comune nell’ambito delle equazioni differenziali ordinarie e viene utilizzato per risolvere una vasta gamma di problemi in vari campi della fisica e dell’ingegneria.

Ad esempio in ambito fisico $t$ potrebbe avere il significato di tempo, e $x(t)$ potrebbe rappresentare lo stato di un un sistema in un dato istante temporale. Le equazioni differenziali rappresentano come il sistema si evolve nel tempo, ma le condizioni iniziali immortalano la situazione ad un dato istante temporale, e stanno ad indicare quale è il punto di partenza da cui evolve il sistema.

Ordine dell’equazione differenziale

Si definisce ordine dell’equazione differenziale, il massimo grado con cui compare il segno di derivata.

Nella forma generale ad esempio l’ordine dell’equazione differenziale è $n$.

$$\Phi \left( t,x,x’,x”,…,{{x}^{(n)}} \right)=0$$

Ad esempio, l’equazione $x”'(t) + 2x”(t) – x'(t) + x(t) = \sin(t)$ è del terzo ordine, mentre l’equazione ${2}^{x”(t)} – x'(t) + x(t) = \sin(t)$ è del secondo ordine.

Equazioni differenziali lineari

Un equazione differenziale, si dice lineare se può essere espressa nella forma:

$${{a}_{n}}\left( t \right){{x}^{(n)}}+{{a}_{n-1}}\left( t \right){{x}^{(n-1)}}+…+{{a}_{1}}\left( t \right)x’+{{a}_{0}}\left( t \right)x=f\left( t \right)$$

come si nota i coefficienti, che moltiplicano le derivate di $x$ non sono necessariamente dei numeri costanti, ma possono essere tranquillamente delle funzioni di $t$.

Ad esempio l’equazione $(e^t + t^2) x”'(t) + 2t x”(t) – (\ln t + \cos(t)) x'(t) + x(t) = \sin(t)$ è lineare, perché è scritta esattamente nella forma di equazione lineare, anche se a prima vista potrebbe non sembrarlo perché compaiono dei termini non lineari. In realtà le quantità non lineari non sono altro che i coefficienti moltiplicativi $a_3(t)=e^t + t^2$, $a_2(t)=2t$, $a_1(t)= \ln t + \cos(t)$ e $a_0(t)=1$, che prendono il nome di coefficienti variabili.

Quando i coefficienti moltiplicativi, sono dei numeri reali, allora l’equazione differenziale si dice lineare a coefficienti costanti.

$${{a}_{n}}\,{{x}^{(n)}}+{{a}_{n-1}}\,{{x}^{(n-1)}}+…+{{a}_{1}}\,x’+{{a}_{0}}\,x=f\left( t \right)$$

Ad esempio, l’equazione $x”'(t) + 2x”(t) – x'(t) + x(t) = \sin(t)$ è un equazione differenziale lineare a coefficienti costanti del terzo ordine.

Soluzione di un equazione differenziale

A questo punto diamo una definizione formale di soluzione di un equazione differenziale e per farlo cerchiamo di essere rigorosi nelle definizioni:

Sia \(f:A\subseteq {{\mathbb{R}}^{k+1}}\to \mathbb{R}\) con \(A\) aperto.

Soluzione locale

Una funzione \(y\) si dice soluzione locale dell’equazione differenziale

$${{x}^{(k)}}=f\left( t,x,{x}’,..,{{x}^{(k-1)}} \right)$$

se rispetta queste condizioni:

1. Il suo dominio è un intervallo, ovvero \(x:I\subseteq \mathbb{R}\to \mathbb{R}\)

2. \(x:I\subseteq \mathbb{R}\to \mathbb{R}\) è derivabile \(k\) volte in \(I\)

3. Per ogni \(t\in I\) risulta \(\left( t,x\left( t \right),{x}’\left( t \right),…,{{x}^{(k-1)}}\left( t \right) \right)\in A\)

4. Per ogni \(t\in I\) risulta verificata l’equazione differenziale.

Prolungamento della soluzione locale

Siano \(z:J\subseteq \mathbb{R}\to \mathbb{R}\) e \(x:I\subseteq \mathbb{R}\to \mathbb{R}\) due soluzioni locali dell’equazione differenziale si dice che \(z\) è un prolungamento della soluzione \(y\) se:

1. \(I\subseteq J\)

2. \(z\left( t \right)=y\left( t \right)\,\,\,\forall t\in I\)

In altre parole \(z\) è un prolungamento della soluzione se è anche essa soluzione, ma risulta definita su un intervallo \(J\) più ampio rispetto a \(I\).

Si dice prolungamento proprio se \(I\subset J\), cioè esiste almeno un elemento del secondo insieme non contenuto nel primo.

Soluzione massimale

Si definisce soluzione massimale se non esiste prolungamento proprio di essa.

Se ad esempio supponiamo che \[x:\left( a,b \right)\to \mathbb{R}\] è soluzione dell’equazione differenziale e in corrispondenza di \({a}^{+}\) e \({b}^{-}\) la funzione presentasse degli asintoti verticali, allora la soluzione non sarebbe prolungabile al di fuori di $(a,b) $ e quindi è di fatto la soluzione massimale.

La soluzione massimale è la soluzione definita sul più ampio intervallo possibile e ricorda che l’intervallo su cui è definita la soluzione di un equazione differenziale deve essere necessariamente un continuo e aperto.

Equazioni differenziali del primo ordine a variabili separabili

\[ \left\{ \begin{align*} & x’ = f(x)g(t) \\ & x(t_0) = x_0 \end{align*} \right. \]

Come si risolvono?

- Prima di iniziare il calcolo, verifichiamo se la soluzione costante $x(t)=x_0$ è soluzione dell’equazione differenziale. Sotto questa condizione avremo che ${x}'(t)=0$ (derivata di una funzione costante, e l’equazione da risolvere per vedere se ammette soluzione: $$x(t_0)f(t)=0$$

- A questo punto bisogna separare le variabili e riscrivere $x’$ nella forma differenziale come $x’=\frac{dx}{dt}$. Fatto ciò otteniamo un’equazione nella forma: $$\frac{dx}{f(x)}=g(t)dt$$

- Una volta separate le variabili e quindi ottenuta un equazione che dipende solo da $x$ a primo membro e solo da $t$ al secondo membro, possiamo passare ad integrare entrambi i membri, avendo cura di aggiungere una costante generica $c$, perchè come ben sappiamo, un integrale indefinito ammette soluzione definita a meno di una costante additiva: $$\int{\frac{1}{f(x)}dx}=\int{g(t)dt}+c$$

- Una volta calcolati entrambi gli integrali possiamo risolvere l’equazione ottenuta cercando di ricavare \(x(t)\), che è l’incognita dell’equazione.

- A questo punto ci ritroviamo che $x(t)$ è un espressione che dipende dalla costante \(c\), ma imponendo la condizione iniziale data dal problema di Cauchy $x(t_0) = x_0$ possiamo finalmente ricavare l’espressione di $x(t)$

Se l’equazione ammette sia soluzione costante che soluzione variabile, allora si tratta di un equazione instabile che ammette infinite soluzioni.

Equazioni differenziali del primo ordine lineari e a coefficienti variabili

\(x’+a\left( t \right)x=b\left( t \right)\)

Le equazioni differenziali del primo ordine lineari e coefficienti variabili possono essere risolte semplicemente applicando la formula dell’integrale generale che fornisce direttamente la soluzione dell’equazione differenziale.

$${x}\left( t \right)=c\,{{e}^{-A\left( t \right)}} +{{e}^{-A\left( t \right)}}\int{{{e}^{A\left( t \right)}}}b\left( t \right)dt$$

Dove:

$$A\left( t \right) = \int{a(t)dt}$$

Quindi, in conclusione possiamo affermare che per risolvere un equazione differenziale del primo ordine lineare a coefficienti variabili, quello che dobbiamo fare è risolvere due integrali: $A\left( t \right) = \int{a(t)dt}$ e $\int{{{e}^{A\left( t \right)}}}b\left( t \right)dt$.

Una volta eseguito il calcolo degli integrali, e sostituiti i risultati nella formula di partenza abbiamo ottenuto quello che prende il nome di integrale generale. Se non abbiamo nessuna condizione iniziale allora abbiamo finito, mentre se il problema è dato sotto forma di problema di Cauchy con condizione iniziale, non ci resta che calcolare la costante $c$ applicando la condizione iniziale $$x(t_0) = x_0$$

Dimostrazione della formula dell’integrale generale

Per dimostrare che

\[x(t) = ce^{-A(t)} + e^{-A(t)}\int{e^{A(t)}}b(t)dt\]

dobbiamo partire dall’equazione differenziale lineare del primo ordine nella forma generale:

\[\frac{dx}{dt} + a(t)x = b(t)\]

dove \(a(t)\) e \(b(t)\) sono funzioni note di \(t\), e \(x(t)\) è la funzione incognita che vogliamo determinare.

Un modo comune per risolvere questa equazione differenziale è utilizzare il metodo del fattore integrante. Il fattore integrante è una funzione, che moltiplicata per l’equazione originale, semplifica l’integrazione della stessa. Il fattore integrante \(\mu(t)\) è dato da:

\[\mu(t) = e^{\int a(t)dt}\]

In questo caso, possiamo identificare \(A(t) = \int a(t)dt\), il che significa che \(e^{A(t)}\) agisce come il nostro fattore integrante. Moltiplichiamo entrambi i lati dell’equazione differenziale originale per \(e^{A(t)}\):

\[e^{A(t)}\frac{dx}{dt} + e^{A(t)}a(t)x = e^{A(t)}b(t)\]

Sostituendo \(a(t)\) con la derivata di \(A(t)\), poiché \(A'(t) = a(t)\), e riconoscendo che \(e^{A(t)}a(t)x = \frac{d}{dt}(e^{A(t)}x)\) per la regola del prodotto della derivata, abbiamo:

\[\frac{d}{dt}(e^{A(t)}x) = e^{A(t)}b(t)\]

Integrando entrambi i lati rispetto a \(t\), otteniamo:

\[e^{A(t)}x = \int e^{A(t)}b(t)dt + C\]

dove \(C\) è una costante di integrazione. Per ottenere \(x(t)\), dividiamo entrambi i lati per \(e^{A(t)}\):

\[x(t) = e^{-A(t)}\left(\int e^{A(t)}b(t)dt + C\right)\]

Qui, \(C\) può essere interpretata come il prodotto di una costante \(c\) e \(e^{-A(t)}\) valutata a un certo punto, che riflette le condizioni iniziali del problema. Pertanto, la formula generale per la soluzione dell’equazione differenziale lineare del primo ordine è:

\[x(t) = ce^{-A(t)} + e^{-A(t)}\int{e^{A(t)}}b(t)dt\]

Questo completa la dimostrazione.

Equazioni differenziali lineari a coefficienti costanti di ordine n

Un equazione differenziale lineare a coefficienti costanti di ordine n, si presenta nella forma:

\[{{a}_{n}}\,{{x}^{(n)}} + {{x}_{n-1}}\,{{x}^{(n-1)}} + \ldots + {{x}_{1}}\,x’ + {{a}_{0}}\,x = f(t)\] dove \({{a}_{0}},\,\,\,{{a}_{1}},\,\,\,…\,\,,\,\,{{a}_{n}}\) sono costanti. Il termine al secondo membro dell’equazione differenziale $f(t)$ prende invece il nome di termine forzante.

La stessa equazione data sotto forma di problema di Cauchy sarà:

\[ \begin{cases} {{a}_{n}}\,{{x}^{(n)}} + {{x}_{n-1}}\,{{x}^{(n-1)}} + \ldots + {{x}_{1}}\,x’ + {{a}_{0}}\,x = f(t) \\ x(t_0) = x_0 \\ x'(t_0) = x’_0 \\ \vdots \\ x^{(n-1)}(t_0) = x^{(n-1)}_0 \end{cases} \]

Dove \(x_0, x’_0, \ldots, x^{(n-1)}_0\) sono i valori iniziali della funzione \(x\) e delle sue derivate fino all’ordine \(n-1\) al punto \(t_0\).

L’integrale generale dell’equazione differenziale è una funzione che dipende da $n$ coefficienti, e per garantire l’unicità della soluzione sono necessarie tante condizioni iniziali, per quanto è l’ordine dell’equazione differenziale.

Equazione omogenea associata

Prende il nome di equazione omogenea associata all’equazione differenziale, la seguente equazione:

\[{{a}_{n}}{{x}^{(n)}}+{{a}_{n-1}}{{x}^{(n-1)}}+…+{{a}_{1}}x’+{{a}_{0}}x=0\]

Si può dimostrare che la soluzione di un equazione differenziale lineare a coefficienti costanti di ordine n è la somma della soluzione dell’equazione omogenea (chiamata soluzione omogenea) e della soluzione che dipende dal termine forzante $f(t)$ (chiamata soluzione particolare)

Teorema sulla soluzione dell’equazione omogenea associata

L’insieme delle soluzioni di un’equazione differenziale omogenea è uno spazio vettoriale di dimensione \(n\). Se \(u\) e \(v\) sono soluzioni, allora:

\[ \left\{ \begin{align*} & u + v \text{ è soluzione} \\ & \lambda u \text{ e } \lambda v \text{ sono soluzioni} \end{align*} \right. \]

Per trovare una base delle soluzioni, si inizia studiando il polinomio caratteristico:

\[p(\lambda) = a_n \lambda^n + a_{n-1} \lambda^{n-1} + \ldots + a_1 \lambda + a_0\]

che è un polinomio di grado \(n\). Si cercano le radici del polinomio caratteristico:

\[a_n \lambda^n + a_{n-1} \lambda^{n-1} + \ldots + a_1 \lambda + a_0 = 0\]

Per il teorema fondamentale dell’algebra, Il polinomio ammette esattamente \(n\) radici in campo complesso, ed alcune potrebbero avere molteplicità algebrica non unitaria. Per ogni radice, si determinano \(k\) elementi della base, dove \(k\) è la molteplicità della radice:

- \(\lambda\) radice reale con molteplicità unitaria: \[\{e^{\lambda t}\}\]

- \(\lambda\) radice reale con molteplicità \(k\): \[\{e^{\lambda t}, te^{\lambda t}, \ldots, t^{k-1} e^{\lambda t}\}\]

- \(\alpha \pm j\beta\) coppia di radici complesse e coniugate con molteplicità unitaria: \[\{e^{\alpha t}\cos(\beta t), e^{\alpha t}\sin(\beta t)\}\]

- \(\alpha \pm j\beta\) coppia di radici complesse e coniugate con molteplicità \(k\): \[\{e^{\alpha t}\cos(\beta t), e^{\alpha t}\sin(\beta t), t e^{\alpha t}\cos(\beta t), t e^{\alpha t}\sin(\beta t), \ldots, t^{k-1} e^{\alpha t}\cos(\beta t), t^{k-1} e^{\alpha t}\sin(\beta t)\}\]

La soluzione omogenea è data dalla combinazione lineare degli \(n\) elementi della base individuata:

\[{x}^{*}(t) = c_1 x_1(t) + c_2 x_2(t) + \ldots + c_n x_n(t)\]

Per la dimostrazione del teorema segui questo link.

Integrale generale dell’equazione differenziale

\[ {{a}_{n}}{{x}^{(n)}}+{{a}_{n-1}}{{x}^{(n-1)}}+\ldots+{{a}_{1}}x’+{{a}_{0}}x=f(t), \quad \text{con } f(t) \neq 0 \]

La soluzione di un’equazione differenziale non omogenea si scrive nella forma:

\[ x(t) = \underbrace{c_{1}x_{1}(t) + \ldots + c_{n}x_{n}(t)}_{\text{soluzione dell’equazione omogenea associata}} + \underbrace{\bar{x}(t)}_{\text{soluzione particolare}} \]

In questa equazione, \(f(t)\) rappresenta la funzione non omogenea, e \(\bar{x}(t)\) è una particolare soluzione dell’equazione non omogenea. La somma \(c_{1}x_{1}(t) + \ldots + c_{n}x_{n}(t)\) rappresenta la soluzione generale dell’equazione omogenea associata.

A questo punto però dobbiamo concentrarci sul calcolo della soluzione particolare, e per fare questo calcolo esistono due metodi:

Metodo della verosimiglianza per il calcolo della soluzione particolare

Il metodo della verosimiglianza afferma che la soluzione particolare è quella più verosimile (che somiglia di più) al termine forzante \(f\left( t \right)\), ma funziona solo per alcuni casi particolari e cioè quando $f(t)$ nel seguente elenco:

- Se \(f(t)\) è nella forma \(\beta \cdot {{e}^{\alpha t}}\), allora la soluzione particolare è: $$\bar{x}\left( t \right)=A \cdot t^k \,{{e}^{\alpha t}}$$ Cerco \(A\) sostituendo $\bar{x}(t)$ all’interno dell’equazione differenziale. Se $\lambda=\alpha$ è tra le soluzioni del polinomio caratteristico, allora $k$ è la molteplicità della soluzione, altrimenti $k=0$

- Se \(f(t)\) è un polinomio di grado $m$, allora la soluzione particolare è: $$\bar{x}\left( t \right)=t^k(A_m\,{{t}^{m}}+A_{m-1}\,{{t}^{m-1}}+…+A_1 t+A_0)$$ Cerco \(A_m,…,A_1,A_0\) sostituendo $\bar{x}(t)$ all’interno dell’equazione differenziale. Se $\lambda=0$ è tra le soluzioni del polinomio caratteristico, allora $k$ è la molteplicità della soluzione, altrimenti $k=0$.

- Se \(f(t)\) è nella forma \(\beta \cdot e^{\alpha t} \cdot (c_1 \cos(\beta t) + c_2 \sin(\beta t))\), allora la soluzione particolare è: \[ \bar{x}(t) = e^{\alpha t} \cdot (A \cos(\beta t) + B \sin(\beta t)) \cdot t^k \] dove \(A\) e \(B\) sono costanti da determinare, e \(k\) è determinato in base alla presenza di \(\alpha \pm j\beta\) come radice del polinomio caratteristico associato all’equazione differenziale omogenea correlata. In particolare, se \(\alpha \pm j\beta\) non è una radice del polinomio caratteristico, allora \(k = 0\), altrimenti \(k\) è la molteplicità di quella radice. Per trovare i valori di \(A\) e \(B\), sostituisci \(\bar{x}(t)\) e le sue derivate nell’equazione differenziale originale e risolvi il sistema di equazioni risultante per \(A\) e \(B\).

- Se \(f\left( t \right)\) è una combinazione lineare delle precedenti, allora la soluzione particolare sarà una combinazione lineare delle precedenti. Questo processo sfrutta il principio di sovrapposizione, dato che l’equazione differenziale è lineare.

In alternativa è possibile utilizzare un metodo più meccanico ma in generale più calcoloso che è quello della variazione delle costanti descritto nel prossimo paragrafo, che è un metodo più generale, ma talvolta più calcoloso.

Metodo della variazione delle costanti (Wronskiano)

Il metodo della variazione delle costanti per calcolare la soluzione particolare di equazioni differenziali lineari a coefficienti costanti, consiste nel calcolare la soluzione particolare a partire da quella omogenea facendo variare le costanti.

La soluzione dell’omogenea associata si calcola come descritto nel primo paragrafo ed è nella forma:

\[{x}^{*}(t) = c_1 x_1(t) + c_2 x_2(t) + \ldots +…+ c_n x_n(t)\]

La soluzione particolare è nella forma:

\[\bar{x}(t) = c_{1}(t) x_{1}(t) + \ldots + c_{n}(t) x_{n}(t) \]

A questo punto quello che bisogna calcolare è il vettore $\mathbf{c}=(c_1(t), c_2(t), … , c_n(t))$ dei coefficienti variabili, e per farlo andiamo a risolvere il seguente sistema lineare:

\[\left\{ \begin{align*} & {{{{c}’}}_{1}}(t){{x}_{1}}(t)+\ldots+{{{{c}’}}_{n}}(t){{x}_{n}}(t)=0 \\ & {{{{c}’}}_{1}}(t){{{{x}’}}_{1}}(t)+\ldots+{{{{c}’}}_{n}}(t){{{{x}’}}_{n}}(t)=0 \\ & \vdots \\ & {{{{c}’}}_{1}}(t){{x}_{1}}^{(n-2)}(t)+\ldots+{{{{c}’}}_{n}}(t){{x}_{n}}^{(n-2)}(t)=0 \\ & {{{{c}’}}_{1}}(t){{x}_{1}}^{(n-1)}(t)+\ldots+{{{{c}’}}_{n}}(t){{x}_{n}}^{(n-1)}(t)=f(t) \\ \end{align*} \right.\]

Il sistema può essere riscritto in forma matriciale come:

\[ \begin{bmatrix} x_1(t) & x_2(t) & \cdots & x_n(t) \\ x_1′(t) & x_2′(t) & \cdots & x_n'(t) \\ \vdots & \vdots & \ddots & \vdots \\ x_1^{(n-2)}(t) & x_2^{(n-2)}(t) & \cdots & x_n^{(n-2)}(t) \\ x_1^{(n-1)}(t) & x_2^{(n-1)}(t) & \cdots & x_n^{(n-1)}(t) \end{bmatrix} \begin{bmatrix} c_1′(t) \\ c_2′(t) \\ \vdots \\ c_n'(t) \end{bmatrix} = \begin{bmatrix} 0 \\ 0 \\ \vdots \\ 0 \\ f(t) \end{bmatrix} \]

La matrice dei coefficienti del sistema prende il nome di matrice Wronskiana:

\[ \mathbf{W}=\begin{bmatrix} x_1 & x_2 & \cdots & x_n \\ x_1′ & x_2′ & \cdots & x_n’ \\ \vdots & \vdots & \ddots & \vdots \\ x_1^{(n-2)} & x_2^{(n-2)} & \cdots & x_n^{(n-2)} \\ x_1^{(n-1)} & x_2^{(n-1)} & \cdots & x_n^{(n-1)} \end{bmatrix} \]

Il sistema può essere risolto con il metodo di Cramer, e fornisce le derivate dei coefficienti variabili $\mathbf{c}’$ che poi integrati forniscono i coefficienti cercati: $ \int{\mathbf{c}’dt}=\mathbf{c} $

A livello operativo, si procede in questo modo:

Si calcola il Wronskiano, che è dato dal determinante della matrice Wronskiana:

\[W(t)=\det \mathbf{W}\]

\({{W}_{i}}(t)\) è il determinante con l’i-esima colonna sostituita da \(f(t)\):

\[ {{W}_{i}}(t)=\det \begin{pmatrix} & & \text{i-esima colonna} & & \\ x_{1} & \cdots & 0 & \cdots & x_{n} \\ x_{1}^{\prime} & \cdots & 0 & \cdots & x_{n}^{\prime} \\ & & \vdots & & \\ x_{1}^{(n)} & \cdots & f(t) & \cdots & x_{n}^{(n)} \\ \end{pmatrix} \]

Dopo aver calcolato tutti i determinanti, si procede al calcolo dei coefficienti risolvendo i seguenti integrali:

\[{{c}_{i}}(t)=\int{\frac{{{W}_{i}}(t)}{W(t)}dt}, \quad i=1,\ldots,n\]

L’integrale generale dell’equazione differenziale è dato dalla somma tra la soluzione omogenea e la soluzione particolare appena ottenuta:

\[x(t)={{x}^{*}}(t)+\bar{x}(t)\]

Sistemi di equazioni differenziali

Nel contesto dei sistemi differenziali lineari omogenei del primo ordine, il teorema di esistenza e unicità della soluzione del problema di Cauchy associato riveste un’importanza fondamentale. Questo teorema garantisce che, sotto determinate condizioni di regolarità, esiste una sola soluzione del sistema differenziale che soddisfa le condizioni iniziali specificate.

La dimensione dello spazio delle soluzioni di tali sistemi è determinata dalla dimensione del vettore dei coefficienti. In particolare, se consideriamo un sistema $n \times n$ con coefficienti costanti, la dimensione dello spazio delle soluzioni può essere determinata attraverso la diagonalizzazione della matrice dei coefficienti.

Se la matrice dei coefficienti è diagonalizzabile, sia in campo reale che complesso, possiamo determinare una base per lo spazio delle soluzioni utilizzando gli autovalori e gli autovettori associati alla matrice dei coefficienti. Questa base ci fornisce un insieme completo e linearmente indipendente di soluzioni.

Tuttavia, nel caso in cui la matrice dei coefficienti non sia diagonalizzabile, come spesso accade nei sistemi $2 \times 2$, dobbiamo adottare un approccio differente. In questo caso, dobbiamo considerare una base che tiene conto dei casi in cui gli autovalori non sono linearmente indipendenti. Questo scenario richiede un’analisi più dettagliata e la ricerca di soluzioni che siano linearmente indipendenti e non diagonalizzabili.

Sistemi di equazioni differenziali omogenee del primo ordine 2×2

\[\mathbf{{v}’}=\mathbf{Av}\]

Il sistema di equazioni differenziali, è un sistema lineare di due equazioni differenziali del primo ordine. Qui c’è una rappresentazione del sistema in forma compatta:

\[ \begin{cases} x’ = a_{11}x + a_{12}y \\ y’ = a_{21}x + a_{22}y \\ \end{cases} \]

Dove \(x\) e \(y\) sono funzioni di \(t\) (solitamente il tempo) e \(a_{11}\), \(a_{12}\), \(a_{21}\), \(a_{22}\) sono costanti. Questo sistema è comunemente noto come sistema di equazioni differenziali lineari omogenee del primo ordine con coefficienti costanti.

Ora vediamo come trovare la soluzione in base alle varie casistiche che possono capitare sugli autovalori della matrice $\mathbf{A}$

1. Autovalori reali e distinti

Nel primo caso che trattiamo, gli autovalori sono reali e distinti e valgono $\lambda$ e $\mu$ con $\lambda \neq \mu$

L’autovalore \(\lambda \) ha tra gli autovettori associati il vettore \(\mathbf{u}_{\lambda }^{{}}\) e \(\mu \) ammette tra gli autovettori \(\mathbf{u}_{\mu }^{{}}\).

Una base per la soluzione è

\[B = \{ e^{\lambda t} \mathbf{u}_{\lambda},\, e^{\mu t} \mathbf{u}_{\mu} \}\]

Esempio

\[ \begin{align*} &\left\{ \begin{aligned} x’ &= x + 2y \\ y’ &= 2x + y \end{aligned} \right. \end{align*} \]

da cui possiamo ottenere la matirce dei coefficienti:

\[ \begin{align*} &\mathbf{A} = \begin{bmatrix} 1 & 2 \\ 2 & 1 \end{bmatrix} \end{align*} \]

La matrice ammette autovalori reali e distinti (calcolo omesso):

\(\lambda = 3\) con possibile autovettore \(\mathbf{u}_{\lambda} = \begin{pmatrix} 1 \\ 1 \end{pmatrix}\)

\(\mu = -1\) con possibile autovettore \(\mathbf{u}_{\mu} = \begin{pmatrix} -1 \\ 1 \end{pmatrix}\).

La soluzione generale dell’equazione in forma vettoriale del sistema di equazioni differenziali è dato da:

\[ \begin{pmatrix} x \\ y \end{pmatrix} = c_{1} e^{3t} \begin{pmatrix} 1 \\ 1 \end{pmatrix} + c_{2} e^{-t} \begin{pmatrix} 1 \\ -1 \end{pmatrix} \]

In forma di sistema invece la soluzione del sistema di equazioni differenziali può essere scritta così:

\[ \left\{ \begin{aligned} x &= c_{1} e^{3t} + c_{2} e^{-t} \\ y &= c_{1} e^{3t} – c_{2} e^{-t} \end{aligned} \right. \]

2. Autovalori complessi e coniugati

\(\lambda =a\pm ib\) , dove \(\mathbf{u}+i\mathbf{v}\) è un autovettore associato a \(a+ib\) .

Una base per la soluzione è

\[ B = \left\{ e^{at} \left( \cos(bt) \mathbf{u} – \sin(bt) \mathbf{v} \right), \quad e^{at} \left( \sin(bt) \mathbf{u} + \cos(bt) \mathbf{v} \right) \right\} \]

Esempio

Consideriamo il seguente sistema di equazioni differenziali:

\[ \begin{cases} x’ = 2x + 2y \\ y’ = -x + 4y \end{cases} \]

La matrice dei coefficienti associata a questo sistema è:

\[ \mathbf{A} = \begin{bmatrix} 2 & 2 \\ -1 & 4 \end{bmatrix} \]

Calcoliamo gli autovalori della matrice \(\mathbf{A}\). Troviamo che gli autovalori sono reali e distinti: \(\lambda_1 = 3 + i\) e \(\lambda_2 = 3 – i\). Per ciascun autovalore, calcoliamo i relativi autovettori.

Per \(\lambda_1 = 3 + i\), un possibile autovettore è dato da \(\mathbf{u}_{\lambda_1} = \begin{pmatrix} 1 – i \\ 1 \end{pmatrix}\), che possiamo scrivere anche come una somma:

\[\mathbf{u}_{\lambda_1} = \begin{pmatrix} 1 \\ 1 \end{pmatrix}+i \cdot \begin{pmatrix} -1 \\ 0 \end{pmatrix}\]

Per \(\lambda_2 = 3 – i\), un possibile autovettore è dato da \(\mathbf{u}_{\lambda_2} = \begin{pmatrix} 1 + i \\ 1 \end{pmatrix}\). Anche in questo caso scomponendo la parte reale dalla parte immaginaria come una somma otteniamo:

\[\mathbf{u}_{\lambda_2} = \begin{pmatrix} 1 \\ 1 \end{pmatrix}+i \cdot \begin{pmatrix} 1 \\ 0 \end{pmatrix}\]

La soluzione generale del sistema è data da:

\[ \begin{pmatrix} x \\ y \end{pmatrix} = c_1 e^{3t} [\cos t \begin{pmatrix} 1 \\ 1 \end{pmatrix} – \sin t \begin{pmatrix} -1 \\ 0 \end{pmatrix}] + c_2 e^{3t} [\sin t \begin{pmatrix} 1 \\ 1 \end{pmatrix} + \cos t \begin{pmatrix} -1 \\ 0 \end{pmatrix}] \]

Dove \(c_1\) e \(c_2\) sono costanti arbitrarie.

In forma esplicita, otteniamo:

\[ \begin{cases} x = e^{3t} [c_1 (\cos t + \sin t) + c_2 (\sin t – \cos t)] \\ y = e^{3t} [c_1 \cos t + c_2 \sin t] \end{cases} \]

3. Autovalore reali e coincidenti (caso non diagonalizzabile)

Un autovettore \(\mathbf{u}\) associato all’autovettore \(\lambda \).

Per determinare una base per la soluzione bisogna cercare un autovettore generalizzato \(\mathbf{v}\), che si ottiene individuando una soluzione del sistema \(\left( \mathbf{A}-\lambda \mathbf{I} \right)\mathbf{v}=\mathbf{u}\).

Una base per la soluzione è

\[B = \{{e}^{\lambda t}\mathbf{u},\ {e}^{\lambda t}(t\mathbf{u} + \mathbf{v})\}\]

Esempio

Consideriamo il seguente sistema di equazioni differenziali:

\[ \begin{cases} x’ = -x + 4y \\ y’ = -x + 3y \end{cases} \]

La matrice dei coefficienti associata a questo sistema è:

\[ \mathbf{A} = \begin{bmatrix} -1 & 4 \\ -1 & 3 \end{bmatrix} \]

Calcoliamo gli autovalori della matrice \(\mathbf{A}\). Troviamo che gli autovettori sono reale e coincidenti: \(\lambda = 1\).

L’autovettore associato è \(\mathbf{u} = \begin{pmatrix} 2 \\ 1 \end{pmatrix}\).

La molteplicità geometrica è 1 mentre la molteplicità algebrica è 2. Si tratta quindi di una matrice non diagonalizzabile.

Cerchiamo l’autovettore generalizzato \(\mathbf{v}\) risolvendo il sistema \((\mathbf{A} – \mathbf{I})\mathbf{v} = \mathbf{u}\), che si riduce a:

\[ \begin{cases} -2x + 4y = 2 \\ -x + 2y = 1 \end{cases} \]

Risolvendo questo sistema otteniamo \(x = 2y – 1\), quindi \(\mathbf{v} = \begin{pmatrix} 2t – 1 \\ t \end{pmatrix}\). Ad esempio, per \(t = 0\), otteniamo \(\mathbf{v} = \begin{pmatrix} -1 \\ 0 \end{pmatrix}\).

La soluzione generale del sistema è quindi:

\[ \begin{pmatrix} x \\ y \end{pmatrix} = e^t \left[ c_1 \begin{pmatrix} 2 \\ 1 \end{pmatrix} + c_2 \begin{pmatrix} 2t – 1 \\ t \end{pmatrix} \right] \]

Esplicitamente, otteniamo:

\[ \begin{cases} x = e^t (2c_1 + 2tc_2 – c_2) \\ y = e^t (c_1 + tc_2) \end{cases} \]

4. Autovalori Reali e Coincidenti (Caso Diagonalizzabile)

Nel caso in cui la matrice \(\mathbf{A}\) sia diagonalizzabile, abbiamo un autovalore \(\lambda\) con molteplicità algebrica uguale alla sua molteplicità geometrica. Questo significa che possiamo trovare un numero sufficiente di autovettori linearmente indipendenti per costruire una base di soluzioni composta interamente da termini del tipo \({e}^{\lambda t}\mathbf{u}_i\), dove ogni \(\mathbf{u}_i\) è un autovettore distinto associato all’autovalore \(\lambda\).

In questo scenario, se \(\lambda\) ha molteplicità algebrica \(m\), e siamo in grado di trovare \(m\) autovettori linearmente indipendenti \(\mathbf{u}_1, \mathbf{u}_2, \ldots, \mathbf{u}_m\), allora una base per le soluzioni del sistema sarà data semplicemente da:

\[B = \{{e}^{\lambda t}\mathbf{u}_1, {e}^{\lambda t}\mathbf{u}_2, \ldots, {e}^{\lambda t}\mathbf{u}_m\}\].

Esempio

Consideriamo il sistema di equazioni differenziali lineari dato da:

\[ \begin{cases} x’ &= 2x \\ y’ &= 2y \end{cases} \]

dove ricaviamo che \(\mathbf{x} = \begin{pmatrix} x \\ y \end{pmatrix}\) e \(\mathbf{A} = \begin{pmatrix} 2 & 0 \\ 0 & 2 \end{pmatrix}\).

Passo 1: Trovare gli Autovalori

Calcoliamo gli autovalori di \(\mathbf{A}\) risolvendo il polinomio caratteristico:

\[\det(\mathbf{A} – \lambda\mathbf{I}) = 0\]

\[\det\left(\begin{pmatrix} 2 & 0 \\ 0 & 2 \end{pmatrix} – \lambda\begin{pmatrix} 1 & 0 \\ 0 & 1 \end{pmatrix}\right) = \det\begin{pmatrix} 2-\lambda & 0 \\ 0 & 2-\lambda \end{pmatrix} = (2-\lambda)^2 = 0\]

Da qui otteniamo che \(\lambda = 2\) è un autovalore di molteplicità algebrica due.

Passo 2: Trovare gli Autovettori

Per trovare gli autovettori associati a \(\lambda = 2\), risolviamo \((\mathbf{A} – 2\mathbf{I})\mathbf{v} = 0\):

\[\begin{pmatrix} 2-2 & 0 \\ 0 & 2-2 \end{pmatrix}\mathbf{v} = \begin{pmatrix} 0 & 0 \\ 0 & 0 \end{pmatrix}\mathbf{v} = 0\]

Ogni vettore non nullo può essere un autovettore in questo caso, dato che stiamo essenzialmente moltiplicando per la matrice zero. Tuttavia, per dimostrare la diagonalizzabilità, dobbiamo trovare due autovettori linearmente indipendenti. Scegliamo:

\[\mathbf{u}_1 = \begin{pmatrix} 1 \\ 0 \end{pmatrix}, \quad \mathbf{u}_2 = \begin{pmatrix} 0 \\ 1 \end{pmatrix}\]

Questi due autovettori sono chiaramente linearmente indipendenti e corrispondono allo stesso autovalore \(\lambda = 2\).

Passo 3: Costruire la Soluzione Generale

La soluzione generale del sistema è quindi una combinazione lineare delle soluzioni corrispondenti a questi autovettori:

\[\mathbf{x}(t) = c_1 e^{2t} \begin{pmatrix} 1 \\ 0 \end{pmatrix} + c_2 e^{2t} \begin{pmatrix} 0 \\ 1 \end{pmatrix} = e^{2t} \begin{pmatrix} c_1 \\ c_2 \end{pmatrix}\]

dove \(c_1\) e \(c_2\) sono costanti determinate dalle condizioni iniziali.

La soluzione in forma implicita del sistema è data da:

\[ \begin{cases} x(t) &= c_1 e^{2t} \\ y(t) &= c_2 e^{2t} \end{cases} \]

Bibliografia

Ecco un elenco di testi consultati per la realizzazione di questa lezione teorico-pratica sulle equazioni differenziali.

- “Lezioni di Analisi Matematica con Esercizi. Parte C. Derivate Parziali, Equazioni Differenziali, Integrali Multipli” di Claudio Canuto e Anita Tabacco. Questo testo, che fa parte di una più ampia serie di libri di testo sulla analisi matematica, dedica una buona parte alla discussione sulle equazioni differenziali, sia ordinarie che parziali, rendendolo una risorsa completa per studenti universitari.

- “Metodi Matematici per l’Ingegneria: Equazioni Differenziali e Trasformate” di Luigi Preziosi. Orientato agli studenti di ingegneria, questo libro copre una vasta gamma di argomenti, inclusi quelli pertinenti alle equazioni differenziali, con un approccio pragmatico che mira a illustrare come queste tecniche siano applicabili alla soluzione di problemi concreti.

- “Introduzione alle Equazioni Differenziali Ordinarie” di Dario Bini e Beatrice Meini. Un testo introduttivo che fornisce le basi teoriche delle equazioni differenziali ordinarie, accompagnate da esempi ed esercizi per facilitare la comprensione degli studenti.

- “Equazioni a Derivate Parziali: Metodi, Modelli e Applicazioni” di Sandro Salsa. Fornisce una panoramica completa delle equazioni a derivate parziali, includendo metodi di soluzione e applicazioni. Sebbene il focus sia sulle equazioni a derivate parziali, la comprensione di questi concetti è spesso cruciale per gli studenti che studiano equazioni differenziali in generale.

- “Analisi Matematica 2” di Marco Bramanti, Carlo D. Pagani e Sandro Salsa. Parte di una serie di testi ben conosciuti per l’analisi matematica, questo volume include capitoli sulle equazioni differenziali, offrendo sia teoria che esercizi risolti e proposti, adatti per studenti di matematica e ingegneria.

Lezioni di Analisi Matematica 2